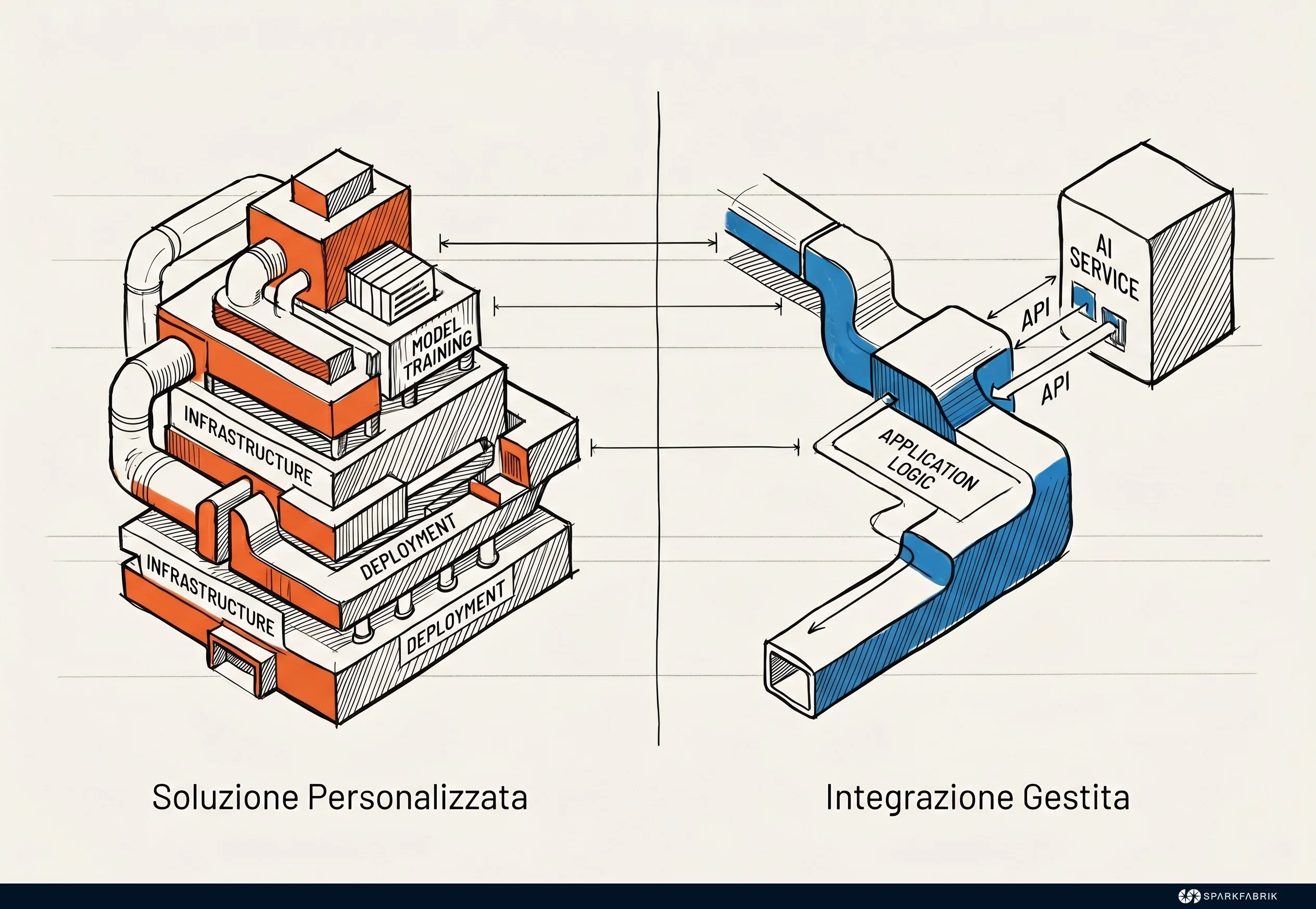

Immagina di aver appena acquistato un motore potentissimo, l’apice dell’ingegneria moderna. Te lo consegnano su un bancale di legno, nudo e crudo. Per poterlo usare in strada, devi costruire da zero l’intera automobile. Dovrai assemblare lo sterzo, i freni, il serbatoio e l’elettronica di bordo. Fino a poco tempo fa, integrare un modello di intelligenza artificiale in un’applicazione aziendale funzionava esattamente così.

Il modello era il motore, ma tutto il resto dell’infrastruttura necessaria per farlo funzionare dovevi costruirtelo da solo.

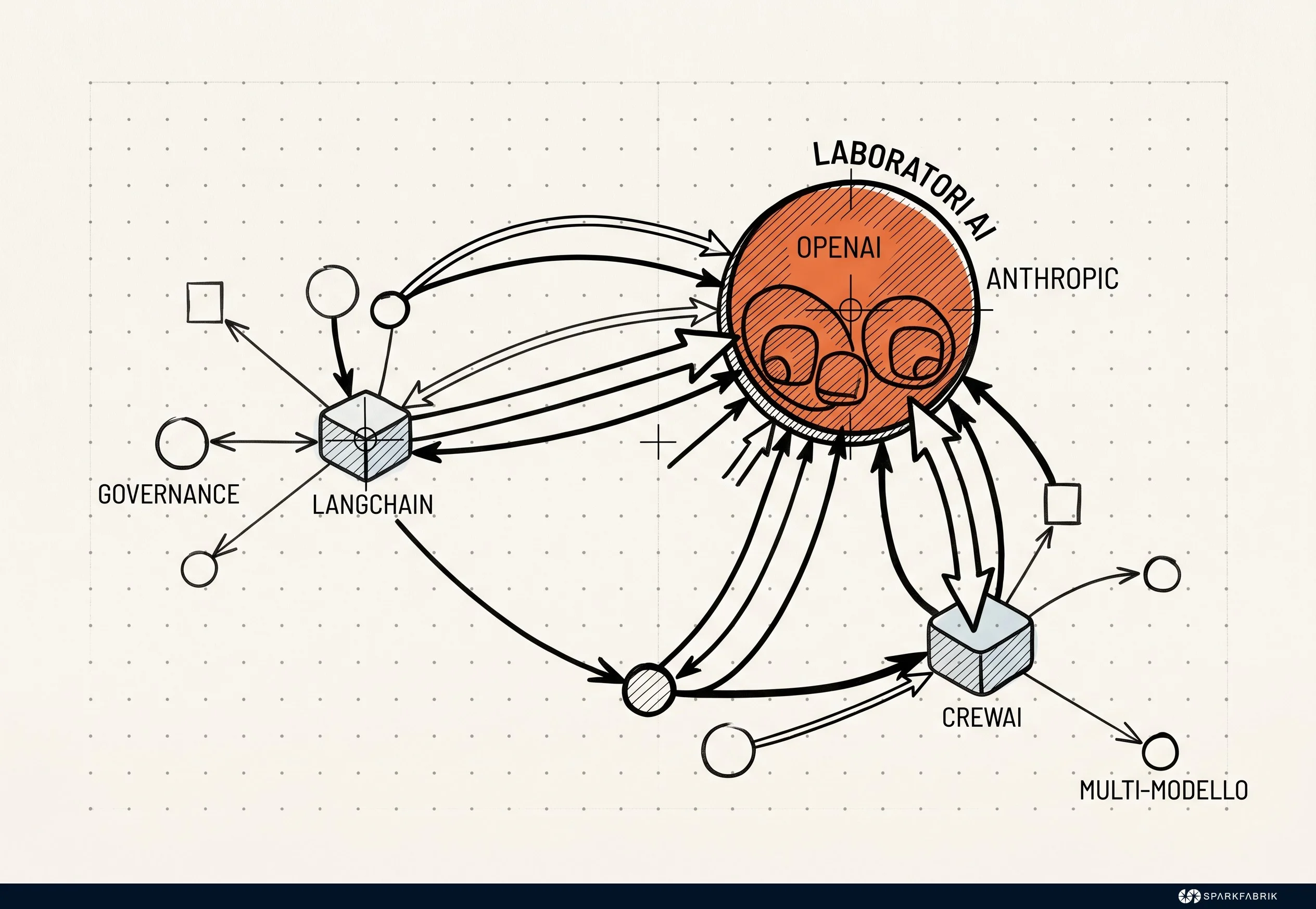

Nella nostra esperienza diretta con architetture cloud native abbiamo visto spesso tecnologie emergenti ridefinire interi mercati. Oggi, i vendor di modelli di frontiera stanno spostando il campo di battaglia sull’infrastruttura di orchestrazione. Il valore si è spostato dall’intelligenza del modello alla solidità dell’harness che lo governa.

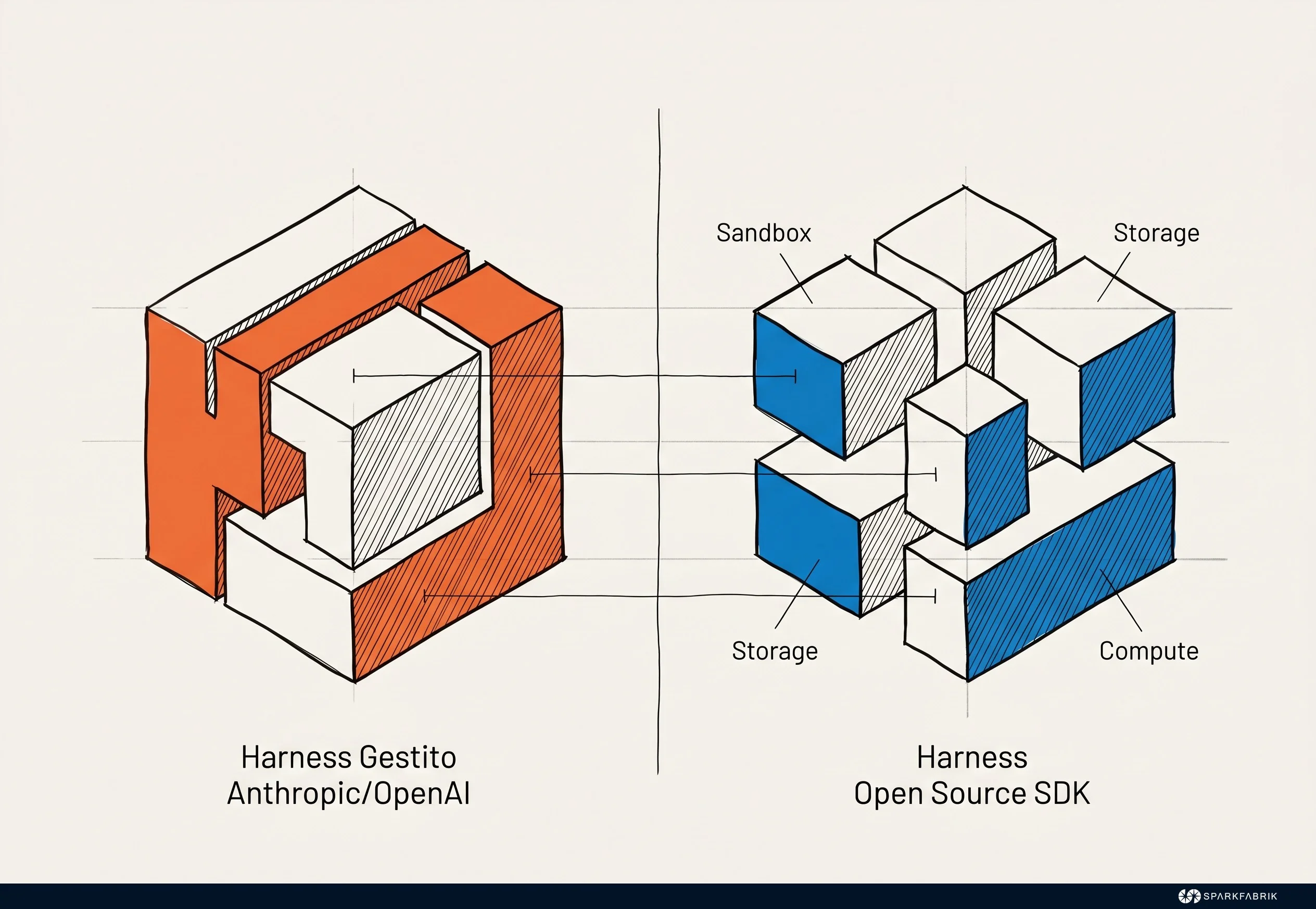

Una lucida analisi di Janakiram MSV pubblicata su The New Stack evidenzia un fatto cruciale. I giganti dell’intelligenza artificiale stanno offrendo questo telaio con modelli di business diametralmente opposti. Anthropic te lo noleggia a ore, come un servizio chiavi in mano. OpenAI ti regala i progetti per costruirlo, sperando che tu usi esclusivamente il suo motore.

Questa divergenza non è una semplice guerra di tariffe cloud. È il momento esatto in cui si definisce il nuovo punto di lock-in architetturale per lo sviluppo di software basati su intelligenza artificiale personalizzata. La scelta tra un servizio gestito o un SDK open source non impatterà solo sulla fattura. Determinerà la portabilità, la flessibilità del sistema e il debito tecnico che le aziende dovranno gestire per il prossimo decennio.

Partiamo da un esempio pratico per capire come questa decisione sull’infrastruttura cambierà radicalmente il modo in cui sviluppiamo software.

Cos’è l’harness e perché è diventato il vero prodotto

La definizione di un nuovo standard

Per comprendere la portata di questo scontro di mercato, dobbiamo prima demistificare l’oggetto della contesa. In estrema sintesi, un modello linguistico (LLM), da solo, si limita a prevedere la parola successiva in base a un calcolo statistico. Non ha memoria delle conversazioni passate, non può interrogare un database aziendale e non può eseguire un’azione su un software esterno.

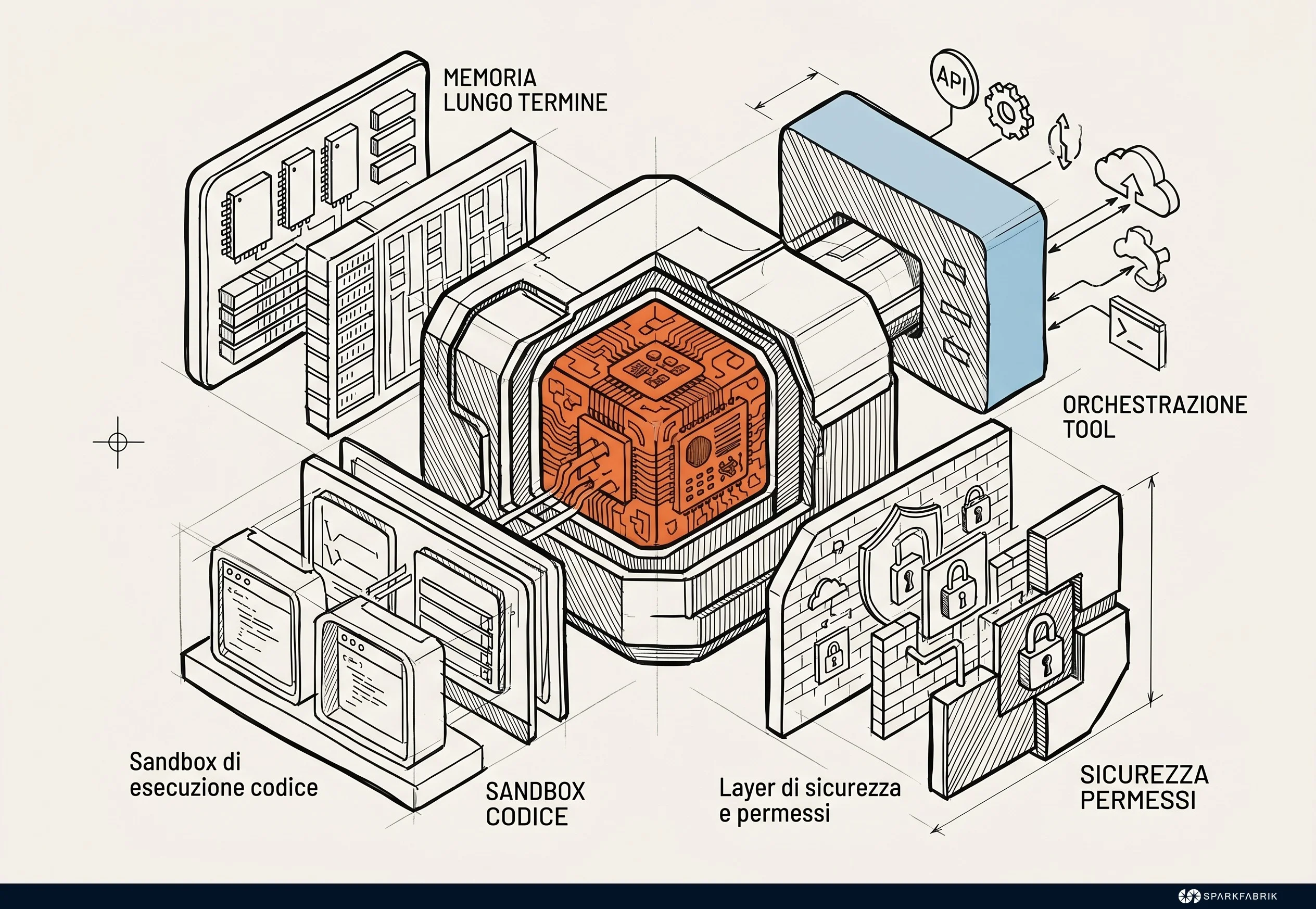

L’harness è il middleware che colma questo vuoto. È il codice che prende la richiesta dell’utente, recupera il contesto storico, interroga le API necessarie, impacchetta tutto per il modello e poi traduce la risposta testuale in un’azione concreta sul sistema.

Il termine ha iniziato a circolare prepotentemente a febbraio. In quel periodo, OpenAI ha pubblicato un post tecnico sul proprio blog descrivendo come un piccolo team interno fosse riuscito a rilasciare in produzione un sistema complesso da 1 milione di righe di codice. La particolarità? Letteralmente zero righe erano state scritte da mani umane.

A canonizzare definitivamente il concetto ci ha pensato Martin Fowler in un lungo saggio, definendo i confini esatti di questa architettura:

A canonizzare definitivamente il concetto ci ha pensato Martin Fowler in un lungo saggio, definendo i confini esatti di questa architettura:

“L’harness è tutto ciò che circonda un modello AI, tranne il modello stesso. È l’infrastruttura di gestione vitale che trasforma un generatore di testo imprevedibile in un operatore software in grado di eseguire compiti in produzione.”

L’harness amministra l’invocazione del modello e la memoria a lungo termine. Si occupa dell’orchestrazione degli strumenti esterni e dell’esecuzione del codice in ambienti isolati (sandbox). Regola inoltre i permessi di sicurezza e il recupero dagli errori. Senza un harness robusto, un agente AI è inutile.

Il costo occulto delle soluzioni fai-da-te

Per 18 mesi, a partire dall’esplosione dell’AI generativa, l’intero mercato ha vissuto in un limbo tecnologico. I vendor cloud e i creatori di framework offrivano solo componenti parziali, frammentati e spesso incompatibili tra loro. Se un’azienda voleva portare un agente AI in produzione, era costretta a fare il lavoro sporco. I team interni dovevano assemblare soluzioni custom incollando parti open source.

Le startup raccoglievano capitali per vendere versioni pre-confezionate di questa infrastruttura. L’harness è diventato un mercato proprio perché i pezzi a disposizione non fornivano una risposta pulita e definitiva alle esigenze enterprise.

Nei nostri percorsi di affiancamento alle aziende, abbiamo osservato le conseguenze dirette di questa frammentazione. Costruire un layer di governo proprietario genera colli di bottiglia. I team devono gestire in prima persona le differenze tra orchestrazione e coreografia nei sistemi complessi. Passano mesi solo per assicurarsi che ogni componente comunichi in modo sicuro e deterministico, distogliendo risorse dallo sviluppo del prodotto reale.

Ora che l’harness ha un nome e un perimetro definito, i creatori dei modelli hanno deciso di riprendersi questo spazio. E lo stanno facendo imponendo visioni del mondo radicalmente diverse.

Il bivio del mercato: l’approccio “tutto compreso” contro l’open source

La via del servizio gestito

La frammentazione degli ultimi diciotto mesi sta per finire, sostituita da una polarizzazione netta. Da un lato abbiamo l’approccio del servizio completamente gestito. Dall’altro troviamo la via dell’infrastruttura aperta ma basata sul principio del bring-your-own-compute.

Anthropic ha tracciato la prima strada lanciando il suo servizio Managed Agents. La promessa è la massima riduzione del carico cognitivo per i team di sviluppo. Tu definisci l’agente, gli strumenti che può usare e i limiti di sicurezza. Anthropic si occupa di far girare l’ambiente di esecuzione. Amministrano le sessioni lunghe, l’esecuzione del codice in sandbox, i permessi e il tracciamento end-to-end.

Il modello di fatturazione è diretto: 0,08 dollari per ora di sessione, in aggiunta al consumo dei token. Non è una tariffa da sandbox o da semplice prototipo. I primi casi d’uso enterprise dimostrano che l’approccio di Anthropic è pronto per la produzione pesante:

Il modello di fatturazione è diretto: 0,08 dollari per ora di sessione, in aggiunta al consumo dei token. Non è una tariffa da sandbox o da semplice prototipo. I primi casi d’uso enterprise dimostrano che l’approccio di Anthropic è pronto per la produzione pesante:

Notion usa questi managed agents per eseguire decine di compiti di delega in parallelo.

Rakuten ha schierato agenti specializzati in vendite, marketing, finanza e risorse umane.

Sentry ha costruito un agente che prende un bug segnalato e lo trasforma in una pull request aperta, senza alcun intervento umano intermedio.

Asana lo ha integrato nella sua funzione AI Teammates.

Siamo davanti al passaggio definitivo dal “fai-da-te” dell’orchestrazione al modello Managed Agents. La vera notizia è la comodità operativa: Anthropic si prende carico dell’infrastruttura di esecuzione (l’harness gestito), lasciando alle aziende solo l’onere della logica di business.

L’alternativa aperta e i costi di ownership

Sette giorni dopo il lancio di Anthropic, OpenAI ha risposto con una mossa speculare e contraria. Ha rilasciato un aggiornamento del suo Agents SDK, rigorosamente open source. Questo strumento include un harness nativo per i modelli OpenAI, offrendo memoria configurabile, orchestrazione e strumenti per il filesystem.

La differenza cruciale è nel modello di delivery e di prezzo.

OpenAI non fa girare il calcolo per te e non applica alcun costo di runtime proprietario o tariffe orarie. Ti fornisce il codice di orchestrazione, ma l’infrastruttura fisica devi mettercela tu. L’SDK supporta nativamente 7 provider di sandbox (Blaxel, Cloudflare, Daytona, E2B, Modal, Runloop e Vercel) e permette di salvare lo stato delle operazioni su sistemi di storage come S3, GCS, Azure Blob e Cloudflare R2.

Il costo totale di ownership cambia radicalmente con questo approccio. Se scegli un agents SDK open source, non paghi la licenza del framework. Tuttavia, dovrai sostenere i costi di elaborazione per i provider di sandbox e le spese di archiviazione cloud per mantenere la memoria degli agenti. Inoltre, dovrai calcolare il costo del tempo ingegneristico necessario per configurare e mantenere questa infrastruttura distribuita.

Questa abbondanza di opzioni infrastrutturali richiama da vicino le sfide della multi cloud orchestration per le organizzazioni. Il costo totale per l’azienda non è zero. Ma OpenAI rinuncia deliberatamente a monetizzare il layer di esecuzione per spingere il consumo puro dei propri modelli.

La terza via: la granularità di Google e Microsoft

Google e Microsoft non stanno a guardare, ma propongono una terza via basata sulla granularità dei servizi. Hanno compreso che le aziende enterprise potrebbero non volere un pacchetto chiuso come quello di Anthropic, ma nemmeno accollarsi l’onere infrastrutturale totale richiesto da OpenAI.

Google, con il suo Gemini Enterprise Agent Platform ha scelto di fatturare a consumo per singoli componenti, frammentando il costo dell’orchestrazione in base a ciò che viene effettivamente utilizzato. Microsoft, con il Foundry Agent Service, applica una tariffazione legata all’uso specifico di strumenti computazionalmente intensivi, come il Code Interpreter. AWS si accoda a questa tendenza preparando uno Stateful Runtime Environment per gestire la memoria a lungo termine in collaborazione con OpenAI e Bedrock AgentCore.

Questi giganti confermano una regola non scritta del nuovo mercato: chi controlla l’harness, controlla i margini di profitto e il lock-in dell’intero ecosistema AI.

La crisi dei framework e il dilemma del team interno

La pressione sulle soluzioni agnostiche

Mentre i titani dell’intelligenza artificiale posizionano le loro pedine infrastrutturali, l’impatto più violento si sta abbattendo sull’ecosistema delle startup. Per mesi, i framework orizzontali hanno prosperato colmando esattamente il vuoto che i grandi vendor avevano lasciato aperto.

Prendiamo il caso dei framework di orchestrazione progettati per essere agnostici rispetto al modello sottostante. Strumenti come LangChain, CrewAI e VoltAgent si trovano ora in una posizione di estrema vulnerabilità. Curiosamente, VoltAgent è sostenuto da investitori di peso come Insight Partners, un fondo che investe anche in OpenAI e Anthropic.

Il loro argomento di vendita principale è sempre stato la flessibilità, promettendo di evitare il legame con un singolo fornitore di AI. Ma come si fa a vendere un layer di orchestrazione agnostico quando il creatore del modello ti regala un harness nativo? Soprattutto se questo strumento è open source, gratuito e perfettamente ottimizzato per le sue API.

La pressione è insostenibile. La promessa di evitare il vendor lock-in perde di attrattiva quando il framework di terze parti introduce latenza o bug di astrazione. Spesso questi strumenti non riescono a tenere il passo con le nuove funzionalità rilasciate dai vendor, spingendo inevitabilmente i team di sviluppo a preferire lo strumento nativo.

Le nicchie di sopravvivenza

Tuttavia, se la competizione sull’orchestrazione di base sembra persa, esistono delle eccezioni strategiche per chi cambia terreno di scontro. Non tutte le startup dell’harness sono destinate a soccombere.

Sycamore, ad esempio, ha recentemente raccolto 65 milioni di dollari in un round seed guidato da Coatue e Lightspeed. Il motivo di questo successo non risiede nel tentativo di competere sull’orchestrazione di base. Si sono concentrati su un problema che i grandi vendor non vogliono risolvere, creando un sistema operativo per l’AI enterprise focalizzato sulla governance e sul controllo multi-modello.

Le grandi aziende hanno bisogno di audit trail inattaccabili. Richiedono strategie architetturali per mitigare i rischi dei sistemi non deterministici e garanzie di compliance rigorose. Sycamore sopravvive perché vende indipendenza e sicurezza a livello aziendale, non solo comodità per lo sviluppatore.

Questa dinamica di mercato ci porta direttamente al cuore del problema per le aziende strutturate. Di fronte alla crisi dei framework orizzontali, l’obiezione classica dei dipartimenti IT riemerge con forza. Molti pensano che se i framework esterni sono a rischio e i servizi gestiti creano lock-in, convenga costruirsi l’harness in casa. Nel contesto dell’intelligenza artificiale generativa, questa è una trappola mortale.

Il vero costo non è in fattura: la lezione del cloud computing

La fine dell’illusione del flat-rate

Il calcolo tra costruire una soluzione interna e acquistarne una di mercato si è arricchito di due nuovi punti di riferimento. Da un lato, il benchmark della comodità: Anthropic ti offre un’infrastruttura completa a 0,08 dollari l’ora. Dall’altro, il benchmark della supervisione: OpenAI ti regala l’architettura base e ti lascia scegliere dove farla girare.

Se pensi che i costi di esecuzione e orchestrazione siano un problema secondario gestibile internamente, guarda cosa sta succedendo ai leader di mercato. Microsoft ha recentemente annunciato che da Giugno 2026 GitHub Copilot abbandonerà il modello di abbonamento flat per passare a una fatturazione a consumo basata su AI Credits.

Il motivo è puramente matematico. I costi di inferenza e di orchestrazione delle sessioni autonome sono diventati insostenibili con una tariffa fissa. Se un gigante come Microsoft deve scaricare i costi di esecuzione sull’utente finale tramite un sistema a consumo, pensare di poter gestire economicamente un’infrastruttura AI custom all’interno di una normale azienda è un azzardo finanziario.

Per i team che sono ancora nella fase di prototipazione, giustificare la costruzione di un’infrastruttura di orchestrazione da zero è diventato indifendibile. Costruire la memoria, gestire i container per il codice e orchestrare i tool era considerato un lavoro differenziante. Oggi è una commodity accessibile tramite una semplice chiamata API o scaricando un SDK gratuito.

Per i team che sono ancora nella fase di prototipazione, giustificare la costruzione di un’infrastruttura di orchestrazione da zero è diventato indifendibile. Costruire la memoria, gestire i container per il codice e orchestrare i tool era considerato un lavoro differenziante. Oggi è una commodity accessibile tramite una semplice chiamata API o scaricando un SDK gratuito.

L’impatto più duro è per i team che hanno già sistemi in produzione. L’obiezione tipica è che l’harness interno sia perfettamente ottimizzato per i carichi di lavoro specifici dell’azienda. La realtà è molto più spietata:

Un team interno di pochi ingegneri non può fisicamente competere con i budget di ricerca di quattro vendor di frontiera. Mantenere quel sistema custom diventerà progressivamente più lento e immensamente più costoso.

Inoltre, diventerà un incubo per il recruiting. Quale ingegnere talentuoso vorrà lavorare alla manutenzione di un harness interno legacy quando il resto del mondo usa standard di mercato?

Il parallelismo storico con le infrastrutture cloud

Abbiamo già visto questo film. La storia dell’infrastruttura cloud ci insegna esattamente come andrà a finire.

Quando il cloud computing è diventato lo standard, il mercato non è stato assorbito da un’unica soluzione monolitica. Terraform è rimasto uno standard open source dominante anche quando AWS spingeva fortemente il suo servizio gestito CloudFormation. Allo stesso modo, abbiamo visto il potenziale dell’open source nell’orchestrazione di infrastrutture scalabili affermarsi con Kubernetes. È diventato lo standard de facto, costringendo AWS, Google e Microsoft a offrire servizi gestiti basati su di esso.

Il mercato dell’harness per l’AI si dividerà seguendo la stessa faglia geologica. L’open source non ucciderà i servizi gestiti, e i servizi gestiti non elimineranno l’open source. Coesisteranno perché rispondono a profili di acquirenti fondamentalmente diversi.

Le aziende che privilegiano il time-to-market graviteranno verso soluzioni come Anthropic Managed Agents. Le organizzazioni che necessitano di amministrazione granulare adotteranno architetture basate sull’SDK di OpenAI o su framework specializzati.

La vera lezione è chiara. L’harness, che fino a ieri doveva essere il fossato difensivo per molte aziende, è diventato a tutti gli effetti l’infrastruttura di base.

Conclusione

L’analisi di Janakiram MSV mette in luce una verità scomoda per l’industria del software. L’infrastruttura di orchestrazione degli agenti AI non è più l’elemento che differenzia il tuo prodotto sul mercato. I giganti tecnologici hanno deciso che il “telaio” deve essere standardizzato, usando la leva del prezzo per imporre le loro architetture, dall’abbonamento orario al regalo open source.

Costruire questa infrastruttura da zero all’interno della propria azienda significa accumulare un debito tecnico che diventerà presto insostenibile. La vera decisione oggi non è stabilire quale modello linguistico sia marginalmente più intelligente in un benchmark sintetico. La decisione critica è scegliere a quale architettura di orchestrazione vuoi legare il destino operativo del tuo software.

Stiamo assistendo a un cambiamento di paradigma verso un approccio agentic-first. Il valore non risiede più nel costruire i tubi dell’infrastruttura, ma nel modo in cui l’intelligenza artificiale orchestra i processi di business reali. Scegliere l’harness sbagliato oggi significa passare i prossimi cinque anni a fare manutenzione idraulica, mentre i tuoi concorrenti inventano il futuro.