L’integrazione dei Large Language Models (LLM) in ambienti di produzione introduce sfide architetturali inedite per i team di ingegneria del software. I modelli di intelligenza artificiale generativa sono per natura sistemi non deterministici, il che significa che lo stesso input può produrre output differenti nel tempo.

Questa variabilità espone le applicazioni enterprise a rischi critici, tra cui allucinazioni, divulgazione involontaria di dati sensibili (PII) e generazione di contenuti in aperto contrasto con le policy aziendali.

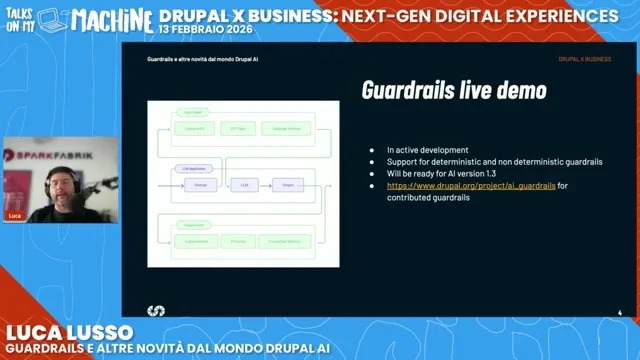

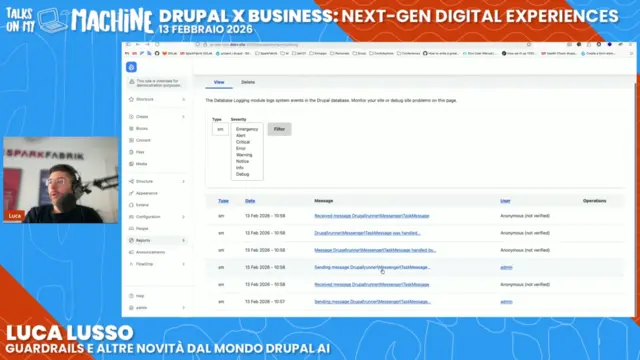

Per mitigare questi rischi, non è sufficiente affidarsi a un prompt engineering accurato. È necessario implementare un livello di controllo strutturale che agisca da intermediario tra l’utente, il content management system (CMS) e il modello linguistico. Durante il talk “Drupal X Business: Next-Gen Digital Experiences”, Luca Lusso, sviluppatore presso SparkFabrik, ha illustrato come l’ecosistema Drupal stia affrontando questa sfida. L’obiettivo è trasformare l’AI da un rischio potenziale a un asset governabile e sicuro.

Con questo articolo esploriamo l’implementazione pratica di queste barriere di sicurezza all’interno del CMS, dalla prospettiva unica di contributors diretti al sistema di guardrails in Drupal. Analizzeremo come configurare le policy di validazione, come orchestrare i flussi di dati tramite agenti autonomi e quali strategie architetturali adottare per proteggere il brand. Per una visione più ampia su come stiamo guidando questa trasformazione, ti invitiamo a leggere come abbiamo plasmato il futuro di Drupal AI nel 2025 e la nostra panoramica completa sulle novità di Drupal AI e la visione di SparkFabrik.

L’adozione di un approccio metodologico rigoroso è l’unico modo per portare l’intelligenza artificiale fuori dalle fasi di sperimentazione e integrarla nei processi mission-critical. I team di Platform Engineering e gli sviluppatori devono collaborare per costruire pipeline dove la sicurezza sia garantita dal design stesso dell’infrastruttura.

Cosa sono i Guardrails AI e perché proteggono il business?

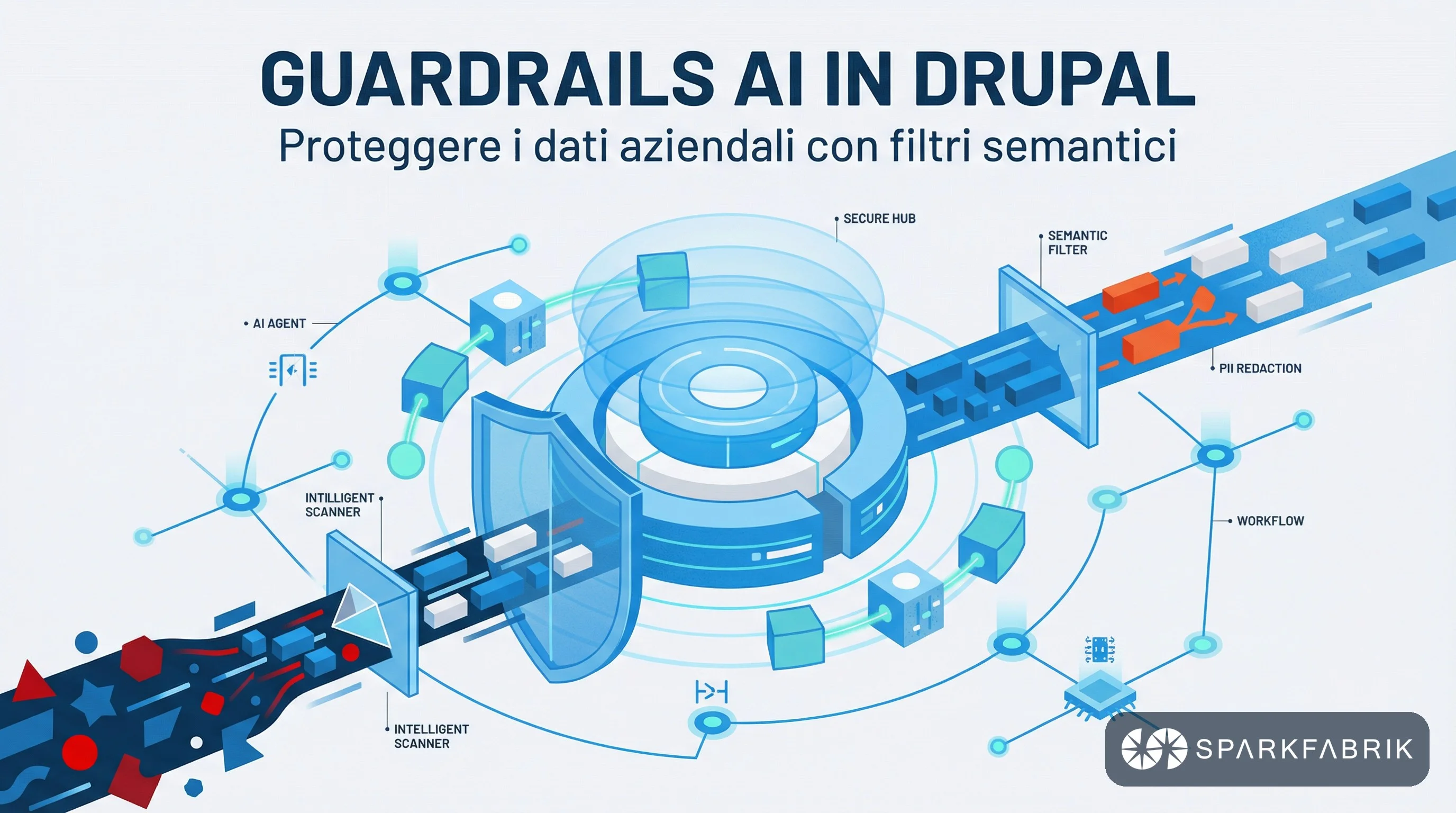

I guardrails AI sono un’infrastruttura di sicurezza architetturale progettata per intercettare, validare e filtrare in tempo reale le comunicazioni tra gli utenti e i Large Language Models (LLM). Operano secondo un approccio security-by-design per garantire che gli output generati rispettino rigorosamente le policy aziendali e le normative sulla privacy.

Questi strumenti non si limitano a essere semplici filtri basati su parole chiave. Rappresentano un vero e proprio strato middleware intelligente che analizza semanticamente il contesto delle conversazioni. Quando un utente invia una richiesta, il sistema la valuta prima che raggiunga il provider esterno, bloccando tentativi di manipolazione o richieste fuori contesto.

La protezione del brand è il principale motore di business per l’adozione di queste tecnologie. Un modello linguistico privo di vincoli espone l’azienda a danni reputazionali enormi, potendo generare risposte non in linea con il tone of voice aziendale, o peggio, contenuti offensivi o discriminatori. Inoltre, l’invio accidentale di dati personali a provider di terze parti costituisce una grave violazione di normative come il GDPR.

Implementare un sistema di validazione robusto si traduce in un immediato vantaggio competitivo. Le aziende che riescono a governare l’imprevedibilità degli LLM possono scalare l’utilizzo dell’intelligenza artificiale su tutti i processi aziendali, dal customer care interno alla generazione automatizzata di contenuti. Questo approccio trasforma un potenziale rischio legale e di immagine in uno strumento di automazione affidabile e certificabile.

Anatomia di un sistema di controllo AI

Un’architettura di validazione moderna si compone tipicamente di due elementi logici fondamentali: i Checker e i Corrector. I Checker sono algoritmi o modelli specializzati che analizzano il payload in transito, verificando la presenza di anomalie, pattern malevoli o violazioni delle policy configurate. Il loro compito è unicamente quello di emettere un verdetto sulla conformità del dato.

I Corrector entrano in gioco successivamente, applicando le azioni di mitigazione necessarie. A seconda della gravità della violazione, possono mascherare parti del testo, riscrivere la risposta in un formato sicuro o bloccare interamente la transazione restituendo un messaggio di errore predefinito. Questa separazione delle responsabilità facilita la manutenzione delle regole.

Nelle architetture Cloud Native gestite dai team di Platform Engineering, questi componenti vengono spesso distribuiti come microservizi indipendenti o sidecar container all’interno di un cluster Kubernetes. Questo isolamento garantisce che le operazioni di validazione, che possono essere computazionalmente intensive, non impattino sulle performance dell’applicazione principale e possano scalare orizzontalmente in base al carico di richieste.

Come funzionano i Guardrails AI: input, output e agenti?

Il funzionamento dei guardrails AI si basa su un controllo bidirezionale continuo. In fase di input, applicano il prompt filtering per bloccare injection malevole o argomenti vietati. In fase di output, eseguono il response filtering per censurare allucinazioni, linguaggio inappropriato e impedire l’esposizione di dati sensibili.

La sicurezza di un’applicazione basata su LLM richiede che nessuna delle due direzioni venga trascurata. Se ci si limita a filtrare l’input, il modello potrebbe comunque produrre allucinazioni basate su dati di addestramento pregressi. Se si filtra solo l’output, si espone l’infrastruttura a costi computazionali inutili per processare prompt malevoli che andavano scartati a monte.

Per comprendere meglio le dinamiche di questo controllo, è utile analizzare i tre ambiti principali di applicazione:

- Filtro in Input (Prompt Filtering): Analizza le intenzioni dell’utente per prevenire attacchi di prompt injection, dove l’utente cerca di sovrascrivere le istruzioni di sistema del modello. Serve anche a mantenere la conversazione confinata agli argomenti pertinenti al business aziendale.

- Filtro in Output (Response Filtering): Valuta la risposta generata dal modello prima di mostrarla all’utente. Rileva e blocca linguaggi tossici, risposte non coerenti con il contesto fornito o informazioni che violano le direttive di compliance aziendale.

- Gestione dei Dati Sensibili (PII Redaction): Identifica informazioni personalmente identificabili, come indirizzi email, numeri di telefono o codici fiscali, all’interno del prompt dell’utente e li sostituisce con placeholder sicuri prima dell’invio al modello.

La gestione delle informazioni sensibili è forse l’aspetto più critico dal punto di vista normativo. Durante l’elaborazione, un sistema di redazione automatica intercetta stringhe come “test@example.com” e le converte in token anonimi come “[EMAIL]”. In questo modo, il modello elabora la richiesta senza mai “vedere” il dato reale, garantendo la totale conformità ai requisiti di data privacy.

Queste policy di sicurezza non si limitano alle interfacce di chat esposte agli utenti umani. Assumono un’importanza ancora maggiore quando si gestiscono workflow automatizzati. Se desideri approfondire come orchestrare queste architetture complesse, puoi leggere la nostra guida su come sviluppare applicazioni cloud native AI-powered, dalla code review ai sistemi multi-agente.

Nei sistemi moderni, gli agenti autonomi comunicano costantemente tra loro e con API di terze parti per eseguire task complessi. In questi scenari, i sistemi di validazione agiscono come veri e propri firewall semantici tra i vari nodi del sistema. Assicurano che un agente con accesso al database non trasmetta inavvertitamente l’intero schema a un modello esterno durante una richiesta di generazione di query.

Implementare i Guardrails in Drupal: configurazione e workflow

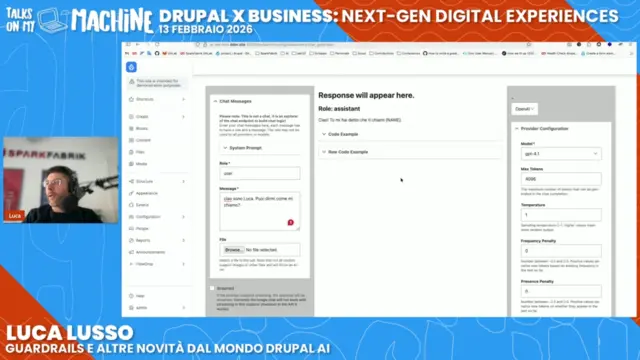

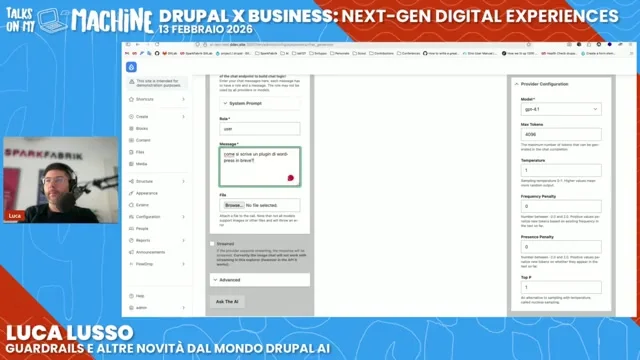

Per implementare i guardrails in Drupal, si utilizza il modulo Drupal AI che permette di configurare policy di validazione tramite interfaccia grafica, orchestrare workflow complessi con Flowdrop AI e automatizzare operazioni tramite Runner API. Questo approccio centralizzato garantisce un controllo rigoroso sugli agenti autonomi e sui flussi di dati.

Il vantaggio principale dell’ecosistema Drupal è la possibilità di gestire logiche complesse di validazione direttamente dal back office, senza dover scrivere codice custom per ogni nuova regola. Il modulo base fornisce l’infrastruttura necessaria, mentre moduli aggiuntivi espandono le tipologie di controlli disponibili, permettendo agli amministratori di sistema di reagire rapidamente a nuove minacce o requisiti di business.

La configurazione di una policy di sicurezza segue un processo logico ben definito, progettato per integrarsi con i flussi di lavoro esistenti dei site builder e degli sviluppatori. Ecco i passaggi fondamentali per attivare un controllo operativo:

- Creazione della singola policy: Si accede alla sezione dedicata nel back office e si seleziona il plugin di validazione desiderato (ad esempio, un controllo basato su servizi cloud esterni o un filtro locale).

- Definizione delle regole di blocco: Si istruisce il sistema sui parametri specifici, come ad esempio la configurazione del plugin “Restrict to Topic” per impedire al modello di generare risposte riguardanti un competitor diretto.

- Impostazione del messaggio di fallback: Si definisce il testo esatto che il sistema deve restituire all’utente quando la policy viene infranta, garantendo un’esperienza utente controllata (es. “Non sono autorizzato a parlare di questo argomento”).

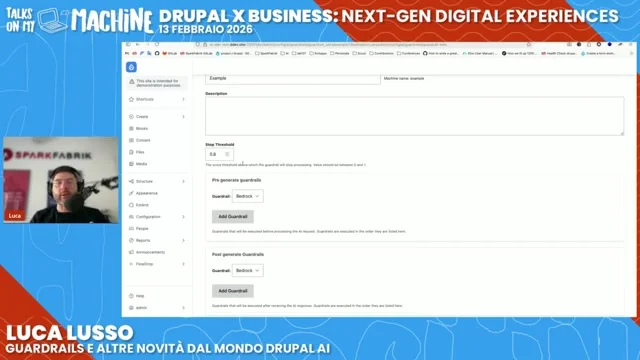

- Assegnazione a un Guardrail Set: Si raggruppano le policy create in insiemi logici, specificando quali regole applicare in fase di input (pre-generazione) e quali in fase di output (post-generazione).

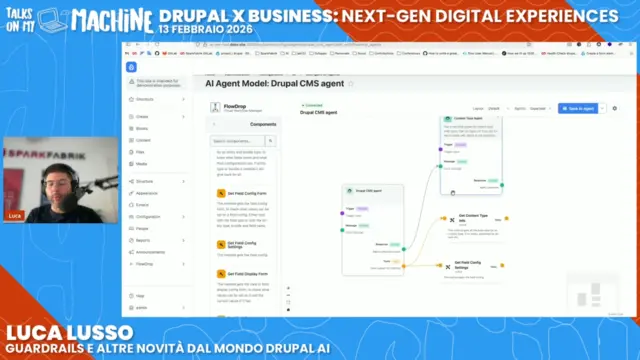

Oltre alla configurazione delle regole statiche, la gestione avanzata richiede strumenti di orchestrazione visiva. In questo contesto si inserisce Flowdrop AI, una soluzione innovativa che permette di disegnare workflow logici attraverso un’interfaccia a nodi. Questo strumento è essenziale per i team di sviluppo che devono costruire pipeline in cui l’output di un modello diventa l’input di un altro, con step di validazione intermedi.

Attraverso Flowdrop AI, è possibile mappare visivamente l’intero ciclo di vita del dato. I nodi di validazione possono essere inseriti strategicamente per verificare che un task intermedio, come l’estrazione di metadati da un PDF, non contenga informazioni sensibili prima di essere passato al nodo incaricato di generare un riassunto pubblico.

Il vero potenziale di questa architettura si esprime quando l’AI non si limita a generare testo, ma compie azioni sul sistema. Le Runner API di Drupal permettono a un agente AI di eseguire operazioni complesse sul CMS partendo da un prompt in linguaggio naturale. Un utente autorizzato potrebbe chiedere all’agente di “creare un nuovo tipo di contenuto per gli Eventi con campi per data e luogo”.

Le Runner API traducono l’intenzione testuale in chiamate API strutturate, creando le entità nel database. In questo scenario, le policy di sicurezza diventano fondamentali per validare i permessi dell’agente e assicurarsi che le operazioni richieste non compromettano l’integrità dell’architettura informativa del sito, mantenendo al contempo un log di audit completo di tutte le azioni eseguite.

Gestione dichiarativa delle policy come codice

Per i DevOps Engineer che gestiscono l’infrastruttura tramite approcci dichiarativi, le policy di sicurezza possono essere definite e versionate come codice. Questo approccio garantisce che le regole aziendali siano replicabili in modo identico in tutti gli ambienti, dallo staging alla produzione.

Invece di operare esclusivamente tramite l’interfaccia utente, i team tecnici possono strutturare file YAML di configurazione che definiscono interi set di regole per mascherare i dati sensibili e bloccare il linguaggio inappropriato. All’interno di queste configurazioni, si stabiliscono identificatori univoci e descrizioni per ogni policy, suddividendo i controlli in due fasi distinte.

Nella fase di pre-generazione, si attivano plugin per la redazione delle PII, specificando entità come email, carte di credito o numeri di telefono da mascherare con appositi caratteri, affiancati da filtri per il linguaggio offensivo in modalità restrittiva.

Nella fase di post-generazione, si configura invece il controllo delle allucinazioni, impostando una soglia di tolleranza e un messaggio di fallback nel caso in cui le informazioni generate non siano presenti nei documenti aziendali.

Questa struttura permette di integrare facilmente le regole di sicurezza all’interno delle pipeline di Continuous Integration, validando le policy prima di ogni rilascio infrastrutturale.

Quali sono le alternative e l’ecosistema tecnologico?

Le alternative ai guardrails in Drupal includono servizi cloud gestiti come Amazon Bedrock, framework open source come Guardrails AI e LangChain, oppure Small Language Models (SLM) on-premise per la massima sicurezza dei dati sensibili. La scelta dipende dai requisiti di compliance, dal budget e dalle competenze del team.

L’ecosistema tecnologico per la validazione dei modelli linguistici offre approcci diversificati che possono essere combinati per creare un’architettura di difesa a strati.

I servizi gestiti dai grandi cloud provider offrono il percorso di adozione più rapido. Amazon Bedrock, ad esempio, mette a disposizione policy pre-configurate per filtrare contenuti tossici, bloccare argomenti specifici e rimuovere PII. Il vantaggio principale di queste soluzioni è la scalabilità nativa e la riduzione del carico operativo per i team interni, che non devono preoccuparsi di aggiornare i dizionari di blocco o mantenere l’infrastruttura di validazione.

Per i team di sviluppo che necessitano di un controllo più granulare, il panorama open source offre strumenti potenti. Esplorando repository github di guardrails ai, si trovano soluzioni flessibili per ogni stack. Ad esempio, Guardrails AI (si chiama proprio così) è un framework in python che permette di scrivere logiche custom complesse, spesso orchestrate tramite LangChain per validare le pipeline di agenti autonomi. Con questi strumenti, uno sviluppatore può implementare controlli strutturali sull’output, assicurandosi ad esempio che il modello restituisca sempre un JSON valido che rispetti uno specifico schema aziendale, bloccando la pipeline in caso contrario.

Nel caso di dati altamente confidenziali, inviare informazioni a un LLM pubblico, per quanto protetto da filtri, potrebbe non essere accettabile. In questi scenari, la strategia architetturale migliore prevede l’adozione di Small Language Models (SLM) specializzati. Questi modelli, più leggeri e focalizzati su task specifici, possono essere eseguiti interamente all’interno dell’infrastruttura aziendale.

Ospitare un SLM su un cluster Kubernetes proprietario garantisce che i dati sensibili non lascino mai il perimetro di rete dell’azienda. Per gestire efficacemente questa complessità infrastrutturale, è fondamentale adottare pratiche moderne di provisioning. A questo proposito, ti suggeriamo di esplorare i vantaggi dell’Infrastructure as Code nello sviluppo Cloud Native, un approccio indispensabile per automatizzare e scalare i deployment di modelli AI on-premise in modo sicuro e riproducibile.

La scelta dell’approccio corretto dipende da diversi fattori, in primis dai requisiti di compliance dell’azienda, dal budget a disposizione e dalle competenze del team di engineers ed architects. Non esiste una soluzione unica per tutti, ma piuttosto un ventaglio di opzioni che possono essere combinati per creare un’architettura di difesa a strati.

Il contributo di SparkFabrik alla Drupal AI Initiative

SparkFabrik contribuisce attivamente alla Drupal AI Initiative sviluppando componenti core per l’integrazione dell’intelligenza artificiale enterprise-grade nel CMS. Il nostro approccio unisce le pratiche di Platform Engineering allo sviluppo applicativo, garantendo soluzioni Cloud Native scalabili, sicure by-design e pronte per ambienti multi-cloud complessi.

In qualità di Kubernetes Certified Service Provider (KCSP) e membro attivo della Cloud Native Computing Foundation (CNCF), la nostra visione va oltre la semplice implementazione di feature. Crediamo che l’adozione dell’AI debba basarsi su fondamenta infrastrutturali solide, dove l’osservabilità, la sicurezza della supply chain del software e la resilienza operativa dei servizi siano garantite fin dalle prime fasi di progettazione.

Il nostro impegno nell’Open Source si traduce in contributi concreti al codice sorgente di Drupal, come discusso anche nel nostro report su DrupalCon Vienna 2025. Sviluppatori del nostro team, come Luca Lusso e Roberto Peruzzo, lavorano quotidianamente per estendere le capacità del modulo AI, introducendo funzionalità avanzate che rispondono alle reali esigenze del mercato enterprise. Per scoprire nel dettaglio le innovazioni tecniche che abbiamo introdotto, ti invitiamo a leggere l’articolo su come abbiamo plasmato il futuro di Drupal AI nel 2025.

La nostra visione architetturale considera il CMS non più come un monolite isolato, ma come un hub intelligente all’interno di un ecosistema distribuito. Quando implementiamo funzionalità di reranking per migliorare le ricerche vettoriali, o sviluppiamo sistemi di orchestrazione per agenti autonomi, lo facciamo pensando a come questi processi si comporteranno sotto stress in un ambiente di produzione containerizzato.

Questo approccio olistico ci permette di supportare le aziende nella creazione di Internal Developer Platforms (IDP) dove l’intelligenza artificiale è integrata in modo nativo e sicuro. L’obiettivo finale non è solo fornire un CMS più intelligente, ma dotare i team IT di strumenti governabili che accelerino il time-to-market senza mai compromettere la stabilità e la sicurezza dell’infrastruttura aziendale.

Conclusioni e prossimi passi

L’implementazione dei guardrails AI rappresenta uno snodo cruciale per l’evoluzione tecnologica delle piattaforme digitali. Queste barriere di sicurezza non devono essere interpretate come un freno all’innovazione, ma piuttosto come il presupposto tecnico e architetturale che rende l’intelligenza artificiale effettivamente utilizzabile in contesti mission-critical e altamente regolamentati.

La roadmap futura per l’ecosistema Drupal prevede sviluppi ancora più avanzati. I prossimi passi si concentreranno sulla generazione automatizzata e intelligente di intere pagine, basata su prompt complessi e contestualizzati. Inoltre, il context management diventerà sempre più sofisticato, permettendo agli agenti autonomi di comprendere a fondo le linee guida del brand e la struttura semantica del sito prima di proporre o eseguire qualsiasi modifica sui contenuti.

Per i Tech Lead, i DevOps Engineer e i CTO, il momento di agire è ora. Integrare l’AI nei propri processi di business richiede una pianificazione architetturale attenta e competenze specifiche nel Platform Engineering.

Scopri come SparkFabrik può aiutarti a implementare guardrails AI enterprise-grade nel tuo Drupal. Contatta il nostro team di architetti certificati per una consulenza personalizzata.

Fonte video

Questo articolo è basato sul video “Guardrails e altre novità dal mondo Drupal AI”.